Le Digital Omnibus veut « réviser » des textes européens, dont le RGPD et l’EUDPR, afin de les rendre plus innovation-compatibles. Mais la remise en question de la notion de données à caractère personnel provoque une levée de boucliers des « Cnil » européennes et des défenseurs de la vie privée.

L’avis conjoint du Comité européen de la protection des données (CEPD/EDPB), qui regroupe les « Cnil » européennes, et de son Contrôleur européen de la protection des données (CEPD/EDPS) était très attendu sur la proposition d’Omnibus numérique que la Commission européenne a présentée le 19 novembre 2025. Celle-ci vise à simplifier le cadre réglementaire numérique des Vingt-sept, à réduire la charge administrative et à renforcer la compétitivité des entreprises européennes. L’avis conjoint, lui, a été publié le 11 février 2026 et il n’est pas tendre avec certaines modifications proposées car elles « suscitent d’importantes préoccupations ».

L’avis conjoint du Comité européen de la protection des données (CEPD/EDPB), qui regroupe les « Cnil » européennes, et de son Contrôleur européen de la protection des données (CEPD/EDPS) était très attendu sur la proposition d’Omnibus numérique que la Commission européenne a présentée le 19 novembre 2025. Celle-ci vise à simplifier le cadre réglementaire numérique des Vingt-sept, à réduire la charge administrative et à renforcer la compétitivité des entreprises européennes. L’avis conjoint, lui, a été publié le 11 février 2026 et il n’est pas tendre avec certaines modifications proposées car elles « suscitent d’importantes préoccupations ».

Notion de données personnelles menacée

Le comité EDPB et le contrôleur EDPS « invitent instamment les colégislateurs » (le Parlement européen et le Conseil de l’Union européenne) à ne pas adopter les modifications proposées – par la Commission européenne – à la définition des données à caractère personnel, « étant donné qu’elles vont bien au-delà d’une modification ciblée ou technique du RGPD », le règlement général sur la protection des données. L’EDPB et l’EDPS estiment en outre que ces modifications concernant la définition des données à caractère personnel « ne reflètent pas exactement et vont clairement au-delà de la jurisprudence » de la Cour de justice de l’Union européenne (CJUE), et elles « aboutiraient à une réduction significative de la notion de données à caractère personnel ».

Les « Cnil » européennes et l’autorité de supervision distincte considèrent ensemble que « la Commission européenne ne devrait pas être chargée de décider, par un acte d’exécution, ce qui n’est plus des données à caractère personnel après la pseudonymisation, étant donné qu’elle a une incidence directe sur le champ d’application du droit de l’Union en matière de protection des données ». Et la présidente du comité EDPB, Anu Talus (photo de gauche), d’insister (suite) : « Nous demandons instamment aux colégislateurs de ne pas adopter les modifications proposées dans la définition des données à caractère personnel, car elles risquent d’affaiblir considérablement la protection des données individuelles ». Et le président du contrôleur EDPS, Wojciech Wiewiórowski (photo de droite), d’abonder : « Nous devons veiller à ce que toute modification du RGPD et du RPDUE [règlement 23 octobre 2018 pour la protection des données à caractère personnel dans l’Union européenne et leur libre circulation] clarifie réellement les obligations et apporte une sécurité juridique tout en maintenant la confiance et un niveau élevé de protection des droits et libertés individuels ».

La proposition « Digital Omnibus » ajouterait un nouveau paragraphe à l’article 4 du RGPD (1) et à l’article 3 de l’EUDPR (2) pour redéfinir les données personnelles de la façon suivante : « Les informations relatives à une personne physique ne sont pas nécessairement des données personnelles pour toute autre personne ou entité, simplement parce qu’une autre entité peut identifier cette personne physique. Les informations ne sont pas personnelles pour une entité donnée lorsque cette entité ne peut pas identifier la personne physique à laquelle les informations se rapportent, en tenant compte des moyens raisonnablement susceptibles d’être utilisés par cette entité. Ces informations ne deviennent pas personnelles pour cette entité simplement parce qu’un destinataire ultérieur potentiel dispose de moyens raisonnablement susceptibles d’être utilisés pour identifier la personne physique à laquelle les informations se rapportent » (3).Cette modification proposée par la Commission européenne veut « codifier » les interprétations de la CJUE, notamment en ce qui concerne la pseudonymisation des données personnelles, en se référant notamment à l’arrêt « EDPS contre SRB » (4) rendu le 4 septembre 2025. C’est là que le bât blesse aux yeux du comité et du contrôleur de la protection des données : « Les modifications proposées introduisent des changements significatifs dans cette définition qui vont au-delà de l’objectif déclaré d’introduire des amendements “ciblés” ou “techniques” au RGPD et à l’EUDPR. […] Modifier la définition des données personnelles aurait un impact direct sur [leur] champ d’application matériel ».

Respecter jurisprudence et droits fondamentaux

Dans leur avis conjoint d’une cinquantaine de pages (5), l’EDPB et l’EDPS tiennent à rappeler que « la définition des données à caractère personnel est au cœur même de la législation de l’UE en matière de protection des données, notamment l’article 8 de la Charte des droits fondamentaux (6) et l’article 16 du traité sur le fonctionnement de l’UE (7) ». Autrement dit, la Commission européenne doit non seulement respecter la jurisprudence de la CJUE mais aussi se conformer aux textes fondamentaux. L’arrêt « EDPS contre SRB », qui a notamment confirmé la jurisprudence précédente telle que celle issue de l’arrêt « GVA contre Scania » (8) du 9 novembre 2023, a rappelé que « des données impersonnelles peuvent devenir de nature personnelle lorsqu’elles sont mises à la disposition d’un destinataire (tout destinataire) avec des moyens raisonnablement susceptibles d’être utilisés pour identifier un sujet de données ».

Digital Omnibus, risque d’insécurité juridique

Digital Omnibus, risque d’insécurité juridique

La CJUE a confirmé que « dans de tels cas, ces données sont des données à caractère personnel tant pour le destinataire que, indirectement, pour l’entité qui met les données à la disposition de ce dernier ». Et les « Cnil » européennes, avec leur contrôleur des données personnelles, d’enfoncer le clou : « Les modifications proposées auraient pour effet de restreindre considérablement la notion de données à caractère personnel, ce qui porterait atteinte au droit fondamental à la protection des données. De plus, la modification proposée pourrait inciter les responsables du traitement à rechercher des failles dans le régime de protection des données et à tenter de contourner l’application du RGPD ou de l’EUDPR. La proposition néglige en outre des éléments clés du concept de données à caractère personnel au titre du considérant 26 du RGPD, tels que le concept de “singularisation” [singling out dans le texte, ndlr] ».

Il est donc reproché à la Commission européenne de créer de la confusion et d’accroître l’insécurité juridique, d’autant que la définition des données à caractère personnel contenue dans le RGPD est mentionnée ou alignée sur d’autres actes juridiques importants de l’UE, tels que la directive « Police-Justice » (9) du 27 avril 2016. « Modifier la définition des données à caractère personnel dans le RGPD pourrait donc avoir des répercussions imprévues sur d’autres actes juridiques et porter atteinte à la cohérence globale du cadre juridique de l’UE », sans parler « des risques de fragmentation avec d’autres cadres juridiques internationaux – comme en particulier la Convention 108 du Conseil de l’Europe (10) – ou avec des lois nationales dans les pays tiers qui jusqu’à présent sont largement alignées ou équivalentes à la définition actuelle dans le cadre du RGPD ». Pour toutes ces raisons, le comité EDPB et le contrôleur EDPS « invitent instamment les colégislateurs à ne pas adopter les modifications proposées de la définition des données à caractère personnel ». Par ailleurs, l’avis conjoint des gendarmes des données rappelle que l’EDPB est en train de préparer des orientations actualisées sur la pseudonymisation et d’élaborer un nouvel ensemble de lignes directrices sur l’anonymisation, qui tiendront compte, entre autres, de l’arrêt « EDPS contre SRB ». A ce propos, les « Cnil » européennes et leur contrôleur se disent « préoccupés par le fait que la proposition permettrait de préciser davantage – au moyen d’un acte d’exécution – les moyens et critères qui déterminent si les données résultant de la pseudonymisation ne constituent plus des données à caractère personnel pour certaines entités ». En effet, la Commission européenne serait habilitée à adopter de tels « actes d’exécution » (11), qui s’appliqueraient également au traitement des données à caractère personnel dans le cadre de l’EUDPR.

Cette modification compléterait la modification proposée à la définition de données personnelles. « La délimitation de ce qui constitue (et de ce qui ne constitue pas) des données à caractère personnel affecte directement le champ d’application du droit de l’UE en matière de protection des données. Un acte d’exécution tel que proposé pourrait de facto affecter le champ d’application matériel de la législation européenne sur la protection des données, redéfinissant effectivement le champ d’application du moment et du destinataire des informations considérées comme des données personnelles », mettent en garde l’EDPB et l’EDPS, lesquels considèrent que « les incidences pratiques de la mise en œuvre des “moyens et critères” énoncés dans les actes d’exécution restent floues et entraînent des difficultés de conformité ». Pour toutes ces raisons encore, l’EDPB et l’EDPS suggèrent donc de « supprimer » la proposition d’acte d’exécution.

L’organisation autrichienne de protection de la vie privée Noyb (nom issu du slogan « None Of Your Business ») s’est aussitôt félicitée de cet avis conjoint : « Les autorités indépendantes ont identifié les changements clés pour ce qu’ils sont : ni “changements techniques” ni “simplification”, mais des limitations du droit à la protection des données pour les résidents de l’UE », a déclaré (12) son dirigeant Max Schrems (photo ci-dessus).

Data et IA : Noyb (Max Schrems) déçu

En outre, du côté de l’entraînement des IA fondé sur « un intérêt légitime » (également traité dans l’avis conjoint du 11 février 2026), Noyb regrette que les « Cnil » européennes et leur contrôleur des données personnelles « ne clarifient pas la question », notamment sur l’utilisation des données à caractère personnel. « De nombreuses autres questions clés concernant l’utilisation des données à caractère personnel dans la formation à l’IA ne seraient pas résolues par la proposition ». @

Charles de Laubier

Le Conseil européen de la protection des données (CEPD) a finalisé l’analyse de sa consultation publique menée il y a un an (en novembre 2024), à la suite de son avis rendu (en avril 2024) sur le modèle de « Pay or Consent ». Basé à Bruxelles et présidé par Anu Talus (photo), le CEPD s’apprête à publier ses lignes directrices pour contrecarrer cette méthode controversée. Ce « contrôleur » européen des données, créé par le règlement général sur la protection des données (RGPD), va aussi tenir compte des résultats d’une autre consultation publique, terminée celle-là le 4 décembre 2025, sur « les lignes directrices conjointes concernant l’interaction entre la Digital Markets Act (DMA) et le RGPD » (

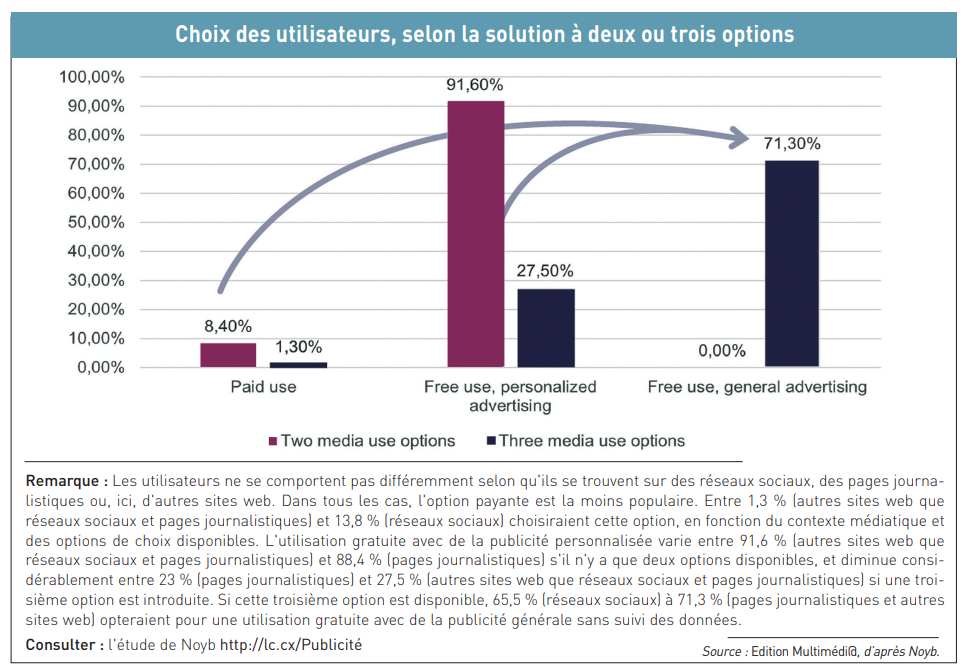

Le Conseil européen de la protection des données (CEPD) a finalisé l’analyse de sa consultation publique menée il y a un an (en novembre 2024), à la suite de son avis rendu (en avril 2024) sur le modèle de « Pay or Consent ». Basé à Bruxelles et présidé par Anu Talus (photo), le CEPD s’apprête à publier ses lignes directrices pour contrecarrer cette méthode controversée. Ce « contrôleur » européen des données, créé par le règlement général sur la protection des données (RGPD), va aussi tenir compte des résultats d’une autre consultation publique, terminée celle-là le 4 décembre 2025, sur « les lignes directrices conjointes concernant l’interaction entre la Digital Markets Act (DMA) et le RGPD » ( 3e option « pas de suivi » plébiscitée

3e option « pas de suivi » plébiscitée

Pour la seconde année consécutive, le mois de décembre aura été riche en décisions rendues par la Commission nationale de l’informatique et des libertés (Cnil) sur la thématique de la gestion des cookies. Alors que le mois de décembre 2021 voyait le gendarme de la protection des données personnelles et de la vie privée prononcer des sanctions administratives contre Google (

Pour la seconde année consécutive, le mois de décembre aura été riche en décisions rendues par la Commission nationale de l’informatique et des libertés (Cnil) sur la thématique de la gestion des cookies. Alors que le mois de décembre 2021 voyait le gendarme de la protection des données personnelles et de la vie privée prononcer des sanctions administratives contre Google ( Il y a plus de trois mois, Russell Ketchum (photo de gauche), directeur de Google Analytics, confirmait qu’Universal Analytics sera remplacé 1er juillet 2023 par la version 4 de Google Analytics (GA4), tandis qu’« Universal Analytics 360 » sera, lui, finalement prolongé jusqu’au 1er juillet 2024 (

Il y a plus de trois mois, Russell Ketchum (photo de gauche), directeur de Google Analytics, confirmait qu’Universal Analytics sera remplacé 1er juillet 2023 par la version 4 de Google Analytics (GA4), tandis qu’« Universal Analytics 360 » sera, lui, finalement prolongé jusqu’au 1er juillet 2024 ( La « Cnil » irlandaise, en l’occurrence la Data Protection Commission (DPC) dirigée par la commissaire Helen Dixon (photo de gauche), a annoncé le 2 septembre 2021 avoir infligé une amende de 225 millions d’euros à la société WhatsApp pour ne pas avoir respecté le règlement européen sur la protection des données personnelles (RGPD) – un record après la condamnation d’Amazon au Luxembourg à payer une sanction pécuniaire de 746 millions d’euros pour avoir aussi enfreint ce même RGPD.

La « Cnil » irlandaise, en l’occurrence la Data Protection Commission (DPC) dirigée par la commissaire Helen Dixon (photo de gauche), a annoncé le 2 septembre 2021 avoir infligé une amende de 225 millions d’euros à la société WhatsApp pour ne pas avoir respecté le règlement européen sur la protection des données personnelles (RGPD) – un record après la condamnation d’Amazon au Luxembourg à payer une sanction pécuniaire de 746 millions d’euros pour avoir aussi enfreint ce même RGPD.